Trong thế giới Technical SEO, việc xây dựng một cấu trúc website hoàn hảo chỉ mới là bước khởi đầu; đảm bảo các công cụ tìm kiếm có thể khám phá và lập chỉ mục dữ liệu đó một cách trọn vẹn mới là chìa khóa định đoạt hiệu suất.

Nếu robots.txt hoạt động như một tấm khiên bảo vệ Crawl Budget khỏi những truy cập lãng phí, thì Sitemap XML chính là “tấm bản đồ chiến lược” định tuyến trực tiếp Googlebot đến những nội dung giá trị nhất của doanh nghiệp.

Đối với các hệ thống quy mô lớn, có cấu trúc phân tầng phức tạp hoặc chứa nhiều trang mồ côi (orphan pages), việc phó mặc hoàn toàn cho cơ chế cào dữ liệu tự nhiên của bot thường dẫn đến rủi ro bỏ sót URL và kéo dài độ trễ Indexing.

Bài viết “Sitemap XML Master Guide“ sẽ giải phẫu toàn diện cơ chế hoạt động của sơ đồ trang web ở cấp độ kỹ thuật. Từ việc chuẩn hóa cấu trúc thẻ khai báo, thiết lập chiến lược phân mảnh Sitemap Index, cho đến các checklist rà soát lỗi thực chiến, bài viết sẽ cung cấp lộ trình chi tiết để bạn chuyển đổi trạng thái từ “khám phá bị động” sang “khai báo chủ động”, giúp website tối ưu hóa triệt để luồng thu thập dữ liệu của công cụ tìm kiếm.

1. Định nghĩa và Phân loại Sitemap

Sitemap đóng vai trò là giao thức kết nối trực tiếp giữa cấu trúc thông tin của website và thuật toán thu thập dữ liệu của các công cụ tìm kiếm.

Bản chất kỹ thuật của Sitemap.xml

Về mặt định nghĩa, Sitemap.xml (Extensible Markup Language) là một tệp văn bản được mã hóa dành riêng cho các trình thu thập dữ liệu (crawler). Tệp này không chỉ cung cấp danh sách URL trần mà còn chứa các siêu dữ liệu (metadata) quan trọng, giúp bot đánh giá tình trạng nội dung. Các tham số kỹ thuật cốt lõi bao gồm:

-

<lastmod>(Last Modified): Thời gian URL được cập nhật nội dung lần cuối. (Đây là tín hiệu quan trọng nhất mà Googlebot hiện đang xem xét để quyết định việc cào lại trang). -

<changefreq>(Change Frequency): Khai báo tần suất thay đổi nội dung dự kiến của trang. -

<priority>(Priority): Mức độ ưu tiên của URL so với các trang khác trong cùng một hệ thống domain (thang điểm từ 0.0 đến 1.0).

Phân loại Sitemap theo tệp dữ liệu

Tùy thuộc vào loại hình dữ liệu và mục tiêu điều hướng, Sitemap được chia thành các định dạng chuyên biệt:

| Loại Sitemap | Đối tượng phục vụ | Định dạng tệp | Mục đích kỹ thuật cốt lõi |

| XML Sitemap | Bot tìm kiếm (Googlebot, Bingbot) | .xml |

Hỗ trợ quá trình Crawling và Indexing luồng dữ liệu chính. |

| HTML Sitemap | Người dùng (User) | .html |

Điều hướng giao diện, tối ưu hóa trải nghiệm người dùng (UX) và củng cố Internal Link. |

| Image Sitemap | Google Images | .xml |

Khai báo siêu dữ liệu hình ảnh, tăng cường khả năng hiển thị trên tab tìm kiếm hình ảnh. |

| Video Sitemap | Google Video | .xml |

Cung cấp metadata về video (thời lượng, thumbnail, mô tả) giúp lập chỉ mục nội dung đa phương tiện. |

| News Sitemap | Google News | .xml |

Dành riêng cho nền tảng báo chí/tin tức, hỗ trợ đẩy nhanh tốc độ cào dữ liệu cho bài viết mang tính thời sự (giới hạn bài viết trong 48h). |

2. Nguyên lý hoạt động và Ứng dụng thực tiễn

Sự hiện diện của Sitemap thay đổi cách tiếp cận của bot từ “khám phá bị động” sang “thu thập chủ động”.

Cơ chế phân bổ và thu thập dữ liệu

Thay vì phải lãng phí thời gian dò dẫm qua từng lớp liên kết nội bộ (Internal Links) phức tạp, hệ thống quản trị có thể chủ động “đệ trình” danh sách URL trực tiếp cho công cụ tìm kiếm thông qua tệp robots.txt hoặc khai báo trên Google Search Console (GSC).

Khi tiếp nhận Sitemap, Googlebot sẽ đối chiếu các URL này. Dựa vào thẻ <lastmod>, bot sẽ ưu tiên đưa các URL mới tạo hoặc vừa được cập nhật nội dung vào hàng đợi thu thập dữ liệu (Crawl Queue). Cơ chế này giúp tối ưu hóa đáng kể nguồn tài nguyên Crawl Budget cho hệ thống.

Ứng dụng chiến lược trong Technical SEO

Việc thiết lập Sitemap chuẩn kỹ thuật mang lại lợi thế cạnh tranh rõ rệt trong các kịch bản sau:

-

Đối với Website mới khởi tạo: Cung cấp bản đồ hoàn chỉnh giúp Google định vị và lập chỉ mục hệ thống URL ngay cả khi trang web chưa xây dựng được mạng lưới backlink hoặc internal link hoàn chỉnh.

-

Đối với hệ thống E-commerce / Website quy mô lớn: Cấu trúc phân nhánh danh mục phức tạp rất dễ tạo ra các trang mồ côi (orphan pages). Sitemap đảm bảo bot không bỏ sót bất kỳ trang sản phẩm hoặc trang đích chuyên sâu nào nằm sâu trong cấu trúc.

-

Đối với nền tảng xuất bản nội dung (News/Blog): Rút ngắn tối đa độ trễ từ khi xuất bản bài viết đến khi xuất hiện trên kết quả tìm kiếm thông qua cơ chế Ping chủ động, đáp ứng tiêu chí cập nhật liên tục của thuật toán.

3. Cấu trúc kỹ thuật và Tiêu chuẩn mã hóa thực tế

Một tệp Sitemap.xml hợp lệ không chỉ đơn thuần là một danh sách liên kết, mà phải tuân thủ nghiêm ngặt các quy chuẩn mã hóa toàn cầu do tổ chức sitemaps.org đề ra. Việc sai lệch định dạng có thể dẫn đến lỗi phân tích cú pháp (parsing error) khiến toàn bộ sơ đồ bị công cụ tìm kiếm từ chối.

Cấu trúc thẻ khai báo cơ bản

Mọi tệp XML Sitemap đều phải bắt đầu bằng thẻ khai báo phiên bản XML và được bao bọc trong không gian tên (namespace) <urlset>.

Dưới đây là một bộ mã hoàn chỉnh cho một URL đơn lẻ:

<?xml version="1.0" encoding="UTF-8"?>

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://truecore.vn/</loc>

<lastmod>2023-10-27T15:30:00+07:00</lastmod>

<changefreq>daily</changefreq>

<priority>1.0</priority>

</url>

</urlset>

(Lưu ý: Thẻ <lastmod> nên được định dạng theo chuẩn thời gian W3C Datetime để đảm bảo độ chính xác tuyệt đối về múi giờ).

Kiến trúc phân tầng: Sitemap Index (Dành cho Website lớn)

Nguyên tắc giới hạn kỹ thuật của một tệp Sitemap đơn lẻ là tối đa 50.000 URL hoặc dung lượng không vượt quá 50MB (khi chưa nén).

Đối với các hệ thống quy mô lớn (như E-commerce, trang tin tức), việc nhồi nhét dữ liệu sẽ gây quá tải bộ nhớ khi bot phân tích tệp. Giải pháp bắt buộc ở đây là sử dụng Sitemap Index. Về bản chất, đây là một “Sitemap chứa các Sitemap con”, giúp chia nhỏ dữ liệu thành các tệp chuyên biệt (ví dụ: sitemap-products.xml, sitemap-articles.xml), cho phép Googlebot tiêu hóa dữ liệu từng phần một cách trơn tru.

Thực tiễn thu thập dữ liệu: Góc nhìn từ Googlebot

Mặc dù cấu trúc chuẩn bao gồm 4 thẻ, nhưng trên thực tế, thuật toán hiện tại của Google đã thay đổi cách tiếp nhận các tín hiệu này để tránh bị các webmaster thao túng:

– <loc> (Bắt buộc): Địa chỉ URL tuyệt đối.

– <lastmod> (Cốt lõi): Đây là tín hiệu quan trọng nhất. Nếu định dạng thời gian chuẩn xác và đồng nhất với thực tế trên trang, Google sẽ tin tưởng sử dụng thẻ này để thiết lập lại lịch trình cào dữ liệu (Recrawl scheduling).

– <priority> và <changefreq> (Vô hiệu): Theo xác nhận từ đội ngũ Google Search Central, hệ thống hiện tại bỏ qua hoàn toàn hai thẻ này. Nguyên nhân là do dữ liệu này mang tính chủ quan (đa số quản trị viên đều đặt priority là 1.0 cho mọi trang). Do đó, bạn không cần tốn tài nguyên hệ thống để cấu hình động cho hai thẻ này; việc loại bỏ chúng còn giúp giảm đáng kể dung lượng tệp XML.

4. Quy trình triển khai và Khai báo kỹ thuật

Việc tạo ra một tệp Sitemap không chỉ là xuất dữ liệu mà là quá trình tinh lọc khắt khe để đảm bảo Googlebot chỉ tiếp cận những tài nguyên thực sự có giá trị.

Giai đoạn trích xuất và tối ưu hóa dữ liệu

Để thiết lập một Sitemap có độ chính xác cao, quản trị viên cần tuân thủ quy trình xử lý dữ liệu sau:

Trích xuất URL hợp lệ: Sử dụng các công cụ rà soát chuyên sâu (như Screaming Frog SEO Spider) hoặc các module phân hệ CMS (như Rank Math, Yoast SEO) để cào toàn bộ website. Mục tiêu là chỉ lấy những URL phản hồi mã trạng thái HTTP 200 OK.

Tinh lọc dữ liệu (Bảo vệ Crawl Budget): Đây là bước sống còn. Một Sitemap “bẩn” sẽ làm giảm độ tin cậy của website trong mắt thuật toán. Bạn bắt buộc phải loại bỏ:

– Các URL mang thẻ khai báo noindex.

– Các trang trùng lặp nội dung đã được xử lý bằng thẻ rel="canonical" trỏ về một URL khác.

– Tuyệt đối không chứa các URL lỗi (404 Not Found, 410 Gone) hoặc các chuỗi chuyển hướng (301, 302 Redirect).

Mã hóa tệp: Xuất danh sách URL đã được làm sạch dưới định dạng .xml chuẩn cấu trúc sitemaps.org.

Tích hợp hệ thống: Tải tệp lên máy chủ (Server), đặt trực tiếp vào thư mục gốc (Root Directory). Đường dẫn tiêu chuẩn để bot dễ dàng định vị thường là [domain.com/sitemap.xml](https://domain.com/sitemap.xml) hoặc [domain.com/sitemap_index.xml](https://domain.com/sitemap_index.xml).

Giao thức đồng bộ với Google Search Console (GSC)

Khai báo Sitemap lên GSC là thao tác “đẩy” (push) dữ liệu chủ động, giúp kích hoạt luồng thu thập của Googlebot mà không cần chờ đợi lịch trình tự nhiên.

– Truy cập vào giao diện quản trị thuộc tính website trên Google Search Console.

– Tại thanh điều hướng bên trái, chọn module Sitemaps (Sơ đồ trang web) nằm trong nhóm Indexing.

– Tại giao diện “Thêm sơ đồ trang web mới”, hệ thống đã mặc định sẵn tiền tố domain. Bạn chỉ cần nhập chính xác hậu tố của tệp (ví dụ: sitemap_index.xml hoặc post-sitemap.xml).

-

Nhấn Gửi (Submit).

-

Kiểm tra trạng thái: Theo dõi cột “Trạng thái”. Một tệp được xử lý hoàn hảo sẽ trả về kết quả Thành công (màu xanh lá).

Lưu ý kỹ thuật: Nếu hệ thống báo lỗi “Không thể tìm nạp” (Couldn’t fetch), nguyên nhân thường bắt nguồn từ việc tệp đang bị chặn bởi chỉ thị trong

robots.txt, sự cố kết nối máy chủ (lỗi 5xx), hoặc cấu trúc XML bị lỗi cú pháp khai báo. Bạn cần xử lý triệt để các lỗi này và gửi lại ngay lập tức.

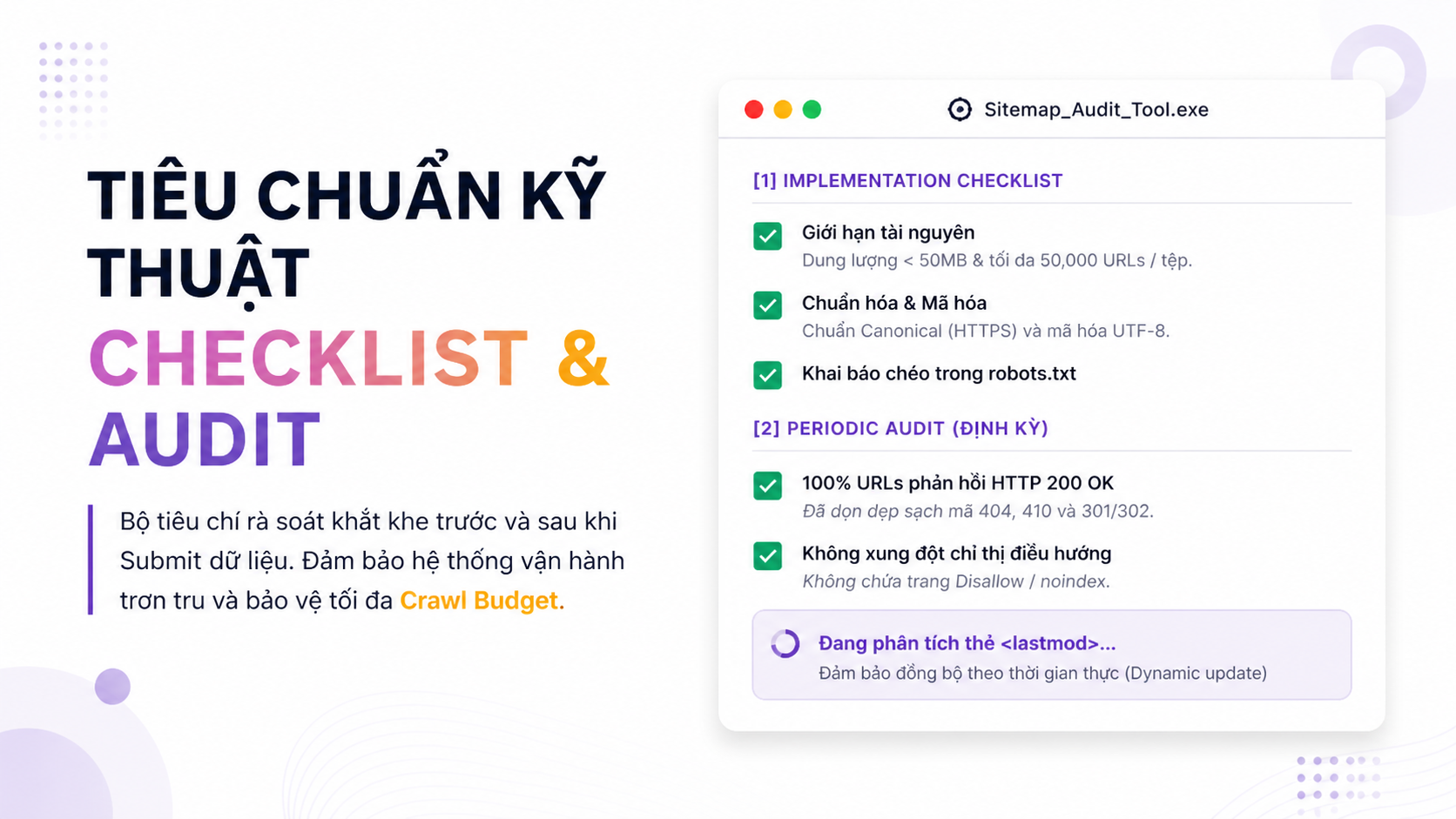

5. Tiêu chuẩn Kỹ thuật: Checklist Triển khai và Audit

Để đảm bảo hệ thống sơ đồ trang web vận hành trơn tru và không gây lãng phí Crawl Budget, mọi quản trị viên cần tuân thủ nghiêm ngặt các bộ tiêu chí rà soát trước và sau khi submit dữ liệu.

Tiêu chuẩn Triển khai (Implementation Checklist)

Trước khi đệ trình lên Google Search Console, tệp XML cần đạt được các trạng thái kỹ thuật sau:

-

[ ] Định dạng dữ liệu: Tệp được lưu dưới chuẩn mã hóa UTF-8 để ngăn chặn mọi lỗi phân tích cú pháp (parsing error) từ bot.

-

[ ] Chuẩn hóa Canonical: Danh sách chỉ bao gồm phiên bản URL cuối cùng và duy nhất. Phải đồng nhất hoàn toàn về giao thức (chỉ dùng HTTPS) và định dạng tên miền (chỉ chọn WWW hoặc Non-WWW).

-

[ ] Giới hạn tài nguyên: Đảm bảo dung lượng tệp không vượt quá giới hạn 50MB (ở trạng thái chưa nén) và tổng số lượng bản ghi không vượt quá 50.000 URL cho mỗi tệp đơn lẻ (nếu vượt quá, phải dùng phân tầng Sitemap Index).

-

[ ] Khai báo chéo: Đã tích hợp chuỗi khai báo tĩnh (ví dụ:

Sitemap: [https://truecore.vn/sitemap.xml](https://truecore.vn/sitemap.xml)) tại phần cuối của tệprobots.txt. Thao tác này đóng vai trò như một điểm chạm thứ hai, hỗ trợ cả những trình thu thập dữ liệu không hoạt động thông qua Google Search Console.

Tiêu chuẩn Rà soát định kỳ (Audit Checklist)

Sitemap không phải là một tệp tĩnh tĩnh. Trong quá trình vận hành, bạn cần thường xuyên audit tệp này để loại bỏ các điểm nghẽn kỹ thuật:

-

[ ] Xung đột chỉ thị điều hướng: Đảm bảo 100% URL trong Sitemap không bị chặn thu thập dữ liệu bởi các quy tắc

Disallowtrongrobots.txthoặc chứa thẻ<meta name="robots" content="noindex">. -

[ ] Mã trạng thái phản hồi (Status Codes): Sitemap là danh sách các URL “sẵn sàng để index”. Do đó, tuyệt đối chỉ chứa các trang trả về mã HTTP 200 OK. Các trang lỗi (404, 410) hoặc các chuỗi chuyển hướng (301, 302, 307) phải được dọn dẹp sạch sẽ.

-

[ ] Tính chân thực của thẻ

<lastmod>: Rà soát để đảm bảo thời gian cập nhật trong thẻ<lastmod>được đồng bộ hoàn toàn theo thời gian thực (dynamic update) mỗi khi nội dung trên trang (văn bản, hình ảnh) có sự thay đổi đáng kể. Việc giả mạo thẻ<lastmod>có thể khiến Googlebot hạ độ tin cậy và phớt lờ tệp Sitemap của bạn.

6. Lỗi kỹ thuật thường gặp và Những lầm tưởng cốt lõi

Trong quá trình quản trị hệ thống, việc triển khai Sitemap không chỉ dừng lại ở bước “Gửi thành công” trên Google Search Console. Quản trị viên cần nắm rõ các rào cản kỹ thuật và loại bỏ ngay những tư duy sai lệch về vai trò thực sự của sơ đồ trang web.

Các điểm nghẽn kỹ thuật phổ biến (Technical Errors)

-

Lỗi phân tích cú pháp (XML Parsing Errors): Định dạng XML cực kỳ nhạy cảm với các lỗi mã hóa. Việc thiếu các thẻ đóng (closing tags) hoặc tồn tại các ký tự đặc biệt không được mã hóa chuẩn (unescaped characters như

&,',") trong URL sẽ khiến tệp bị hỏng cấu trúc. Khi đó, Googlebot sẽ lập tức từ chối cào và trả về lỗi “Không thể đọc sơ đồ trang web” trên GSC. -

Xung đột chỉ thị và lãng phí Crawl Budget: Sai lầm nghiêm trọng nhất là đẩy các trang đã gắn thẻ

noindex, trang bị chặn bởirobots.txt, hoặc trang lỗi (404/5xx) vào Sitemap. Điều này tạo ra “tín hiệu nhiễu”, buộc Googlebot lãng phí ngân sách thu thập dữ liệu vào những URL không có giá trị hiển thị, đồng thời làm chậm quá trình quét các trang đích quan trọng. -

Sự cố Sitemap tĩnh (Stale Sitemap): Việc khai báo thời gian

<lastmod>cũ kỹ hoặc tệp không được cấu hình cập nhật động (dynamic update) khi có nội dung mới sẽ làm sai lệch thông tin. Ngược lại, nếu cố tình thao túng<lastmod>(cập nhật ngày giờ mới nhưng nội dung trang không đổi), Google sẽ đánh giá thấp độ tin cậy của tệp và chủ động giảm tần suất (crawl rate) ghé thăm website trong tương lai.

Giải mã những lầm tưởng trong quản trị SEO

Lầm tưởng 1: “Khai báo Sitemap đồng nghĩa với việc URL sẽ được Index”

Sự thật: Khai báo Sitemap về bản chất chỉ là một “giao thức đề xuất” (discovery mechanism). Bạn cung cấp bản đồ, nhưng Google có theo dõi hay không lại là câu chuyện khác. Quyết định lập chỉ mục cuối cùng phụ thuộc hoàn toàn vào thuật toán đánh giá chất lượng.

Các trang có nội dung mỏng (thin content), trùng lặp, hoặc không mang lại giá trị cho người dùng dù có nằm trong sitemap chuẩn xác đến đâu vẫn sẽ bị GSC xếp vào trạng thái “Đã khám phá – hiện chưa được lập chỉ mục” (Discovered – currently not indexed) hoặc “Đã thu thập dữ liệu – hiện chưa lập chỉ mục“ (Crawled – currently not indexed).

Lầm tưởng 2: “Sitemap trực tiếp làm tăng thứ hạng từ khóa”

Sự thật: Sitemap không phải là một yếu tố xếp hạng (Ranking factor). Thứ hạng của một URL bị chi phối bởi các yếu tố cốt lõi như giá trị nội dung, trải nghiệm người dùng (Core Web Vitals), và tín hiệu off-page. Tuy nhiên, Sitemap cung cấp lợi thế chiến lược về mặt thời gian nhằm đảm bảo cấu trúc dữ liệu của bạn được công cụ tìm kiếm hiểu đúng, hiểu đủ và index nhanh nhất có thể. Đây là nền tảng kỹ thuật vững chắc để các nỗ lực tối ưu SEO khác có cơ hội phát huy tối đa sức mạnh.

7. Ví dụ thực tiễn và Chiến lược tối ưu nâng cao (Expert Tips)

Lý thuyết kỹ thuật chỉ thực sự phát huy tác dụng khi được áp dụng vào các bài toán hệ thống thực tế. Dưới đây là cách triển khai cấu trúc Sitemap cho các dự án quy mô lớn và những đúc kết từ quá trình vận hành Technical SEO.

Case Study: Phân mảnh Sitemap cho hệ thống Thương mại điện tử (E-commerce)

Giả sử bạn đang quản trị một website TMĐT có khối lượng dữ liệu khổng lồ với hơn 100.000 SKU sản phẩm. Thay vì nhồi nhét toàn bộ URL vào một tệp sitemap.xml duy nhất – điều này sẽ gây quá tải bộ nhớ và dễ dẫn đến rủi ro timeout khi bot phân tích – chiến lược tối ưu nhất là chia nhỏ luồng dữ liệu (Silos).

Hệ thống sẽ được phân mảnh thành các tệp chuyên biệt:

-

sitemap-products-1.xml(chứa 40.000 SKU đầu tiên) -

sitemap-products-2.xml(chứa 40.000 SKU tiếp theo) -

sitemap-products-3.xml(chứa 20.000 SKU còn lại) -

sitemap-categories.xml(chứa URL các danh mục ngành hàng) -

sitemap-posts.xml(chứa URL bài viết blog/tin tức)

Toàn bộ các tệp con này sẽ được khai báo tập trung thông qua một tệp mục lục duy nhất là sitemap-index.xml. Khi hệ thống có sản phẩm mới, máy chủ chỉ cần render và cập nhật lại tệp sitemap-products-3.xml đang còn sức chứa. Điều này giúp tối ưu hóa triệt để tài nguyên Server và kiểm soát chính xác tốc độ thu thập dữ liệu của Googlebot cho từng nhóm nội dung.

Kinh nghiệm thực chiến từ chuyên gia (Expert Tips)

-

Tự động hóa hoàn toàn (Dynamic Sitemap): Tuyệt đối không tạo và cập nhật tệp XML bằng phương pháp thủ công. Hãy tận dụng các plugin SEO (đối với WordPress) hoặc thiết lập các tác vụ tự động (Cron jobs) trên hệ thống máy chủ để Sitemap tự động render và cập nhật thẻ

<lastmod>theo thời gian thực mỗi khi có sự thay đổi dữ liệu trên web. -

Chuyển đổi giao thức Ping sang Indexing API:

Lưu ý cập nhật quan trọng: Trong quá khứ, các chuyên gia SEO thường sử dụng cú pháp Ping (

[http://www.google.com/ping?sitemap=URL_CUA_BAN](http://www.google.com/ping?sitemap=URL_CUA_BAN)) để ép bot cào dữ liệu ngay lập tức. Tuy nhiên, Google đã chính thức ngừng hỗ trợ endpoint Ping sitemap này từ đầu năm 2024.Hiện tại, để thông báo nội dung mới một cách nhanh nhất, bạn nên thiết lập cấu trúc XML chuẩn xác, đệ trình qua Google Search Console, hoặc ứng dụng trực tiếp Google Indexing API đối với các trang web có tính cập nhật thời gian thực cao (như tuyển dụng, tin tức).

-

Kiểm toán độ chênh lệch trên GSC (Indexing Gap): Hãy thường xuyên theo dõi báo cáo Lập chỉ mục trang trong Google Search Console. Nếu bạn nhận thấy tỷ lệ chênh lệch lớn giữa lượng “URL được phát hiện” (Discovered URLs trong sitemap) so với “URL được lập chỉ mục” (Indexed URLs), thì vấn đề không còn nằm ở cấu trúc Sitemap.

-

Đó là tín hiệu cảnh báo đỏ từ Google về việc chất lượng nội dung đang quá mỏng (thin content), trang bị lỗi rendering, hoặc ngân sách thu thập dữ liệu (Crawl Budget) của hệ thống đã bị cạn kiệt.

Nhìn chung, Sitemap XML không phải là một “phép thuật” có thể trực tiếp thao túng thuật toán xếp hạng, mà là nền tảng kỹ thuật bắt buộc để tối ưu hóa quy trình thu thập dữ liệu (Crawling) và lập chỉ mục (Indexing). Bằng cách thiết lập một cấu trúc Sitemap chuẩn mực, phân tách luồng dữ liệu thông minh (Sitemap Index) và tuân thủ các quy trình rà soát lỗi (Audit) khắt khe, bạn hoàn toàn có thể kiểm soát cách Googlebot tương tác với hệ thống của mình.

Thay vì phó mặc nguồn tài nguyên Crawl Budget quý giá cho cơ chế dò dẫm tự nhiên qua các lớp liên kết nội bộ, một chiến lược đệ trình Sitemap bài bản trên Google Search Console sẽ đảm bảo mọi trang đích giá trị nhất đều được định vị và cập nhật trong thời gian ngắn nhất. Technical SEO là một quá trình bảo trì liên tục; hãy biến tệp sitemap.xml của bạn thành một “tấm bản đồ sống”, luôn đồng bộ hoàn hảo với sự mở rộng và phát triển không ngừng của website.

Tôi là Nguyễn Thị Thu Thảo – Đồng sáng lập Truecore.vn và sáng lập tuilathao.com với hơn 9 năm làm việc trong ngành công nghệ, dịch vụ doanh nghiệp và pháp lý số, Thảo lựa chọn trở thành người đứng sau những chuyển đổi mạnh mẽ, bền vững cho các doanh nghiệp – từ khi thành lập đến khi mở rộng thị trường.