Trong quản trị kỹ thuật website, việc xây dựng nội dung chỉ là một nửa chặng đường; nửa còn lại là đảm bảo các công cụ tìm kiếm có thể truy cập và phân tích nội dung đó một cách tối ưu. Khi cấu trúc trang web mở rộng, nguồn tài nguyên mà Googlebot phân bổ để quét dữ liệu website (Crawl Budget) trở nên đặc biệt quý giá và hữu hạn. Việc để bot lãng phí thời gian vào các URL kém quan trọng, trang quản trị nội bộ hoặc các bộ lọc tham số không chỉ làm tiêu hao ngân sách cào mà còn làm chậm tiến độ nhận diện các trang đích cốt lõi.

Tệp robots.txt đóng vai trò là “người điều phối giao thông” đầu tiên mà mọi bot tìm kiếm phải đọc trước khi tiến sâu vào cấu trúc site. Bài viết “Robots.txt Optimization: Chiến lược điều hướng Bot và tối ưu Crawl Budget cho Website” sẽ đi sâu vào các phương pháp thiết lập bộ quy tắc kỹ thuật chuẩn xác.

Từ việc rà soát dữ liệu thu thập trên Google Search Console đến việc thiết lập các chỉ thị Allow/Disallow hợp lý, chúng ta sẽ cùng tìm hiểu cách kiểm soát luồng di chuyển của bot, ngăn chặn các truy cập gây lãng phí tài nguyên và cải thiện hiệu suất kỹ thuật tổng thể của website một cách thực tế và hiệu quả nhất.

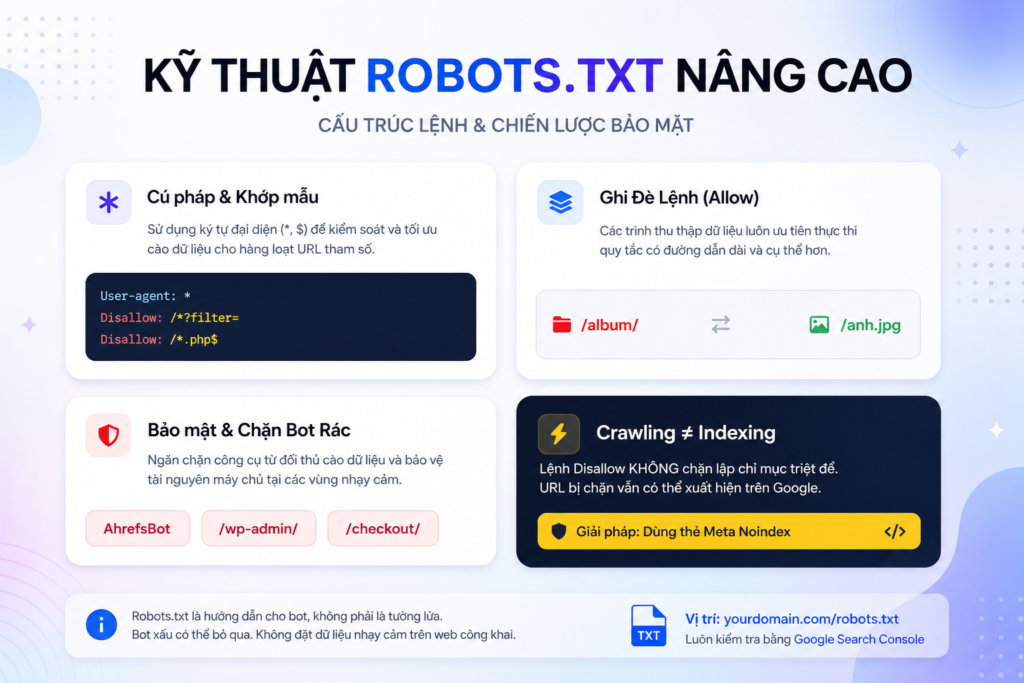

1. Tổng quan về tệp Robots.txt

Tệp robots.txt là một tệp văn bản thuần túy (plain text) được đặt trực tiếp tại thư mục gốc của website. Trong quy trình cào dữ liệu, đây luôn là điểm “chạm” đầu tiên của các trình thu thập dữ liệu (như Googlebot, Bingbot) trước khi chúng tiến hành quét qua các nội dung khác trên trang.

– Bản chất kỹ thuật: Robots.txt hoạt động dựa trên Giao thức loại trừ robot (Robots Exclusion Protocol). Tệp này đóng vai trò như một bộ quy tắc giao tiếp chuẩn mực, chỉ định rõ những khu vực (thư mục, URL) trên website mà crawler được phép truy cập (Allow) hoặc bị hạn chế (Disallow).

– Cơ chế hoạt động: Cấu hình robots.txt vận hành dựa trên nguyên tắc tự nguyện (Voluntary Compliance). Các bot uy tín từ công cụ tìm kiếm lớn luôn nghiêm túc tuân thủ các chỉ thị này. Tuy nhiên, cần lưu ý rằng robots.txt không phải là tường lửa (Firewall); các bot rác (spam bots) hoặc trình quét mã độc lậu hoàn toàn có thể phớt lờ tệp này để cào dữ liệu trái phép.

2. Bảng tóm tắt các lệnh cơ bản trong Robots.txt

Để dễ dàng nắm bắt và triển khai, dưới đây là bảng tổng hợp các thành phần cú pháp quan trọng nhất cấu thành nên một tệp robots.txt tiêu chuẩn, cùng với tác động trực tiếp của chúng đến Technical SEO:

| Thành phần lệnh | Chức năng kỹ thuật cốt lõi | Tác động đến SEO & Bảo mật |

| User-agent | Xác định đối tượng Bot mục tiêu (ví dụ: Googlebot, Bingbot hoặc * cho tất cả). |

Thiết lập phân quyền và cá nhân hóa luồng truy cập cho từng loại trình thu thập dữ liệu cụ thể. |

| Disallow | Ngăn chặn bot cào dữ liệu tại một thư mục, đường dẫn hoặc tệp tin nhất định. | Tối ưu hóa Crawl Budget (Ngân sách thu thập dữ liệu), tránh lãng phí tài nguyên vào các trang rác hoặc trang nội bộ. |

| Allow | Ghi đè lệnh Disallow, cấp quyền truy cập ngoại lệ cho một tệp/thư mục lồng bên trong. |

Đảm bảo bot hiển thị (render) trang chính xác bằng cách cấp quyền truy cập các tài nguyên thiết yếu (CSS, JS, hình ảnh). |

| Sitemap | Khai báo đường dẫn tuyệt đối (Absolute URL) đến tệp sitemap.xml của website. |

Lập sơ đồ cấu trúc nhanh chóng, thúc đẩy tốc độ khám phá URL và lập chỉ mục (Index). |

| Crawl-delay | Giới hạn tốc độ và khoảng thời gian giãn cách giữa các lần quét (Lưu ý: Googlebot hiện không còn hỗ trợ lệnh này). | Giảm tải tài nguyên cho máy chủ (Server), ngăn chặn tình trạng quá tải do bot quét với tần suất quá dày đặc. |

3. Cấu trúc kỹ thuật và Ứng dụng chỉ thị Disallow/Allow

Việc nắm vững cú pháp kỹ thuật trong robots.txt là nền tảng bắt buộc để quản lý luồng cào dữ liệu. Bất kỳ sai sót nhỏ nào trong việc thiết lập chỉ thị cũng có thể dẫn đến rủi ro nghiêm trọng, thậm chí vô tình loại bỏ toàn bộ website khỏi hệ thống dữ liệu của công cụ tìm kiếm (Deindexed).

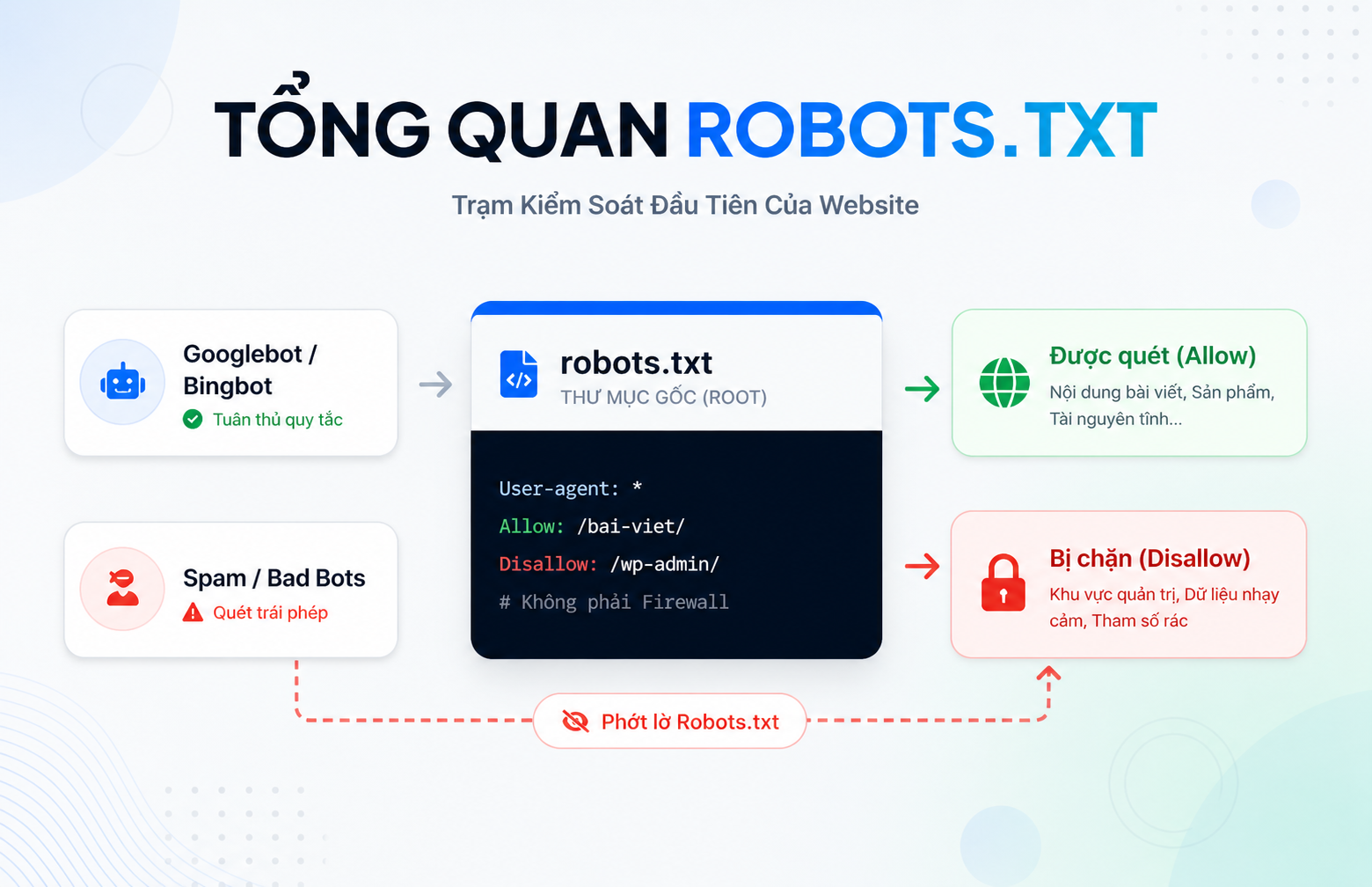

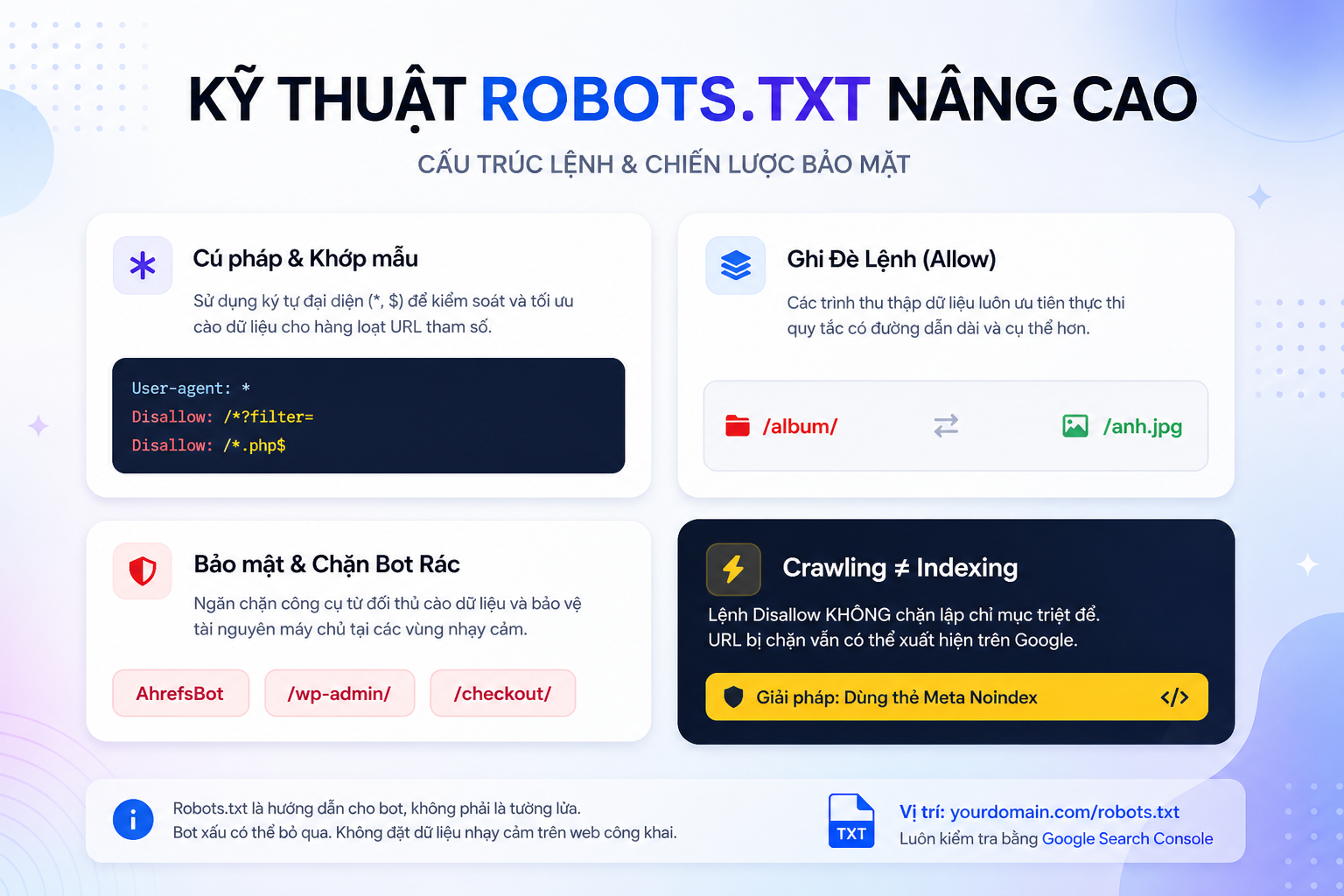

Cú pháp cơ bản và Pattern Matching (Khớp mẫu)

Một khối lệnh tiêu chuẩn luôn bắt đầu bằng việc khai báo định danh trình thu thập dữ liệu thông qua User-agent.

Bên cạnh cấu hình cơ bản (sử dụng dấu * để áp dụng quy tắc cho tất cả các bot), quá trình thiết lập nâng cao thường ứng dụng các ký tự đại diện (Pattern Matching) để xử lý URL hàng loạt:

-

Dấu hoa thị (

*– Wildcard): Đại diện cho một chuỗi ký tự bất kỳ hợp lệ trong URL. -

Dấu đô la (

$– End of URL): Chỉ định điểm kết thúc tuyệt đối của một chuỗi. Khai báo này đóng vai trò then chốt trong việc giới hạn chính xác phạm vi chặn, giúp tránh tình trạng chặn nhầm các URL có chung tiền tố nhưng khác tham số phía sau.

Kỹ thuật kết hợp và ghi đè Allow/Disallow

Khi thiết lập đồng thời cả hai lệnh Allow và Disallow trong cùng một thư mục, các trình cào dữ liệu sẽ xử lý xung đột dựa trên tính cụ thể của đường dẫn (Path Specificity).

Nguyên tắc cơ bản: Lệnh nào có chuỗi ký tự dài hơn và chi tiết hơn sẽ được ưu tiên thực thi.

Ví dụ cấu hình: Bạn muốn chặn bot quét toàn bộ dữ liệu trong thư mục /album/, nhưng lại muốn giữ quyền thu thập dữ liệu (crawl) cho một tệp hình ảnh cụ thể bên trong thư mục đó để làm SEO hình ảnh.

User-agent: Googlebot

Disallow: /album/

Allow: /album/anh-dep.jpg

Ngoại lệ cốt lõi: Crawling không đồng nghĩa với Indexing

Một nguyên lý Technical SEO cực kỳ quan trọng cần làm rõ: Robots.txt không phải là công cụ dùng để chặn lập chỉ mục (Index).

-

Bản chất của lệnh Disallow: Chỉ thị này chỉ ngăn bot thu thập dữ liệu (Crawl) trực tiếp. Nếu URL bị chặn đó nhận được các liên kết nội bộ (internal link) hoặc liên kết trỏ về từ website khác (backlink), Google vẫn có thể lập chỉ mục trang và hiển thị trên kết quả tìm kiếm (thường là một kết quả trống mô tả nội dung).

-

Giải pháp xử lý: Để chặn lập chỉ mục một trang web một cách triệt để, quản trị viên bắt buộc phải chèn thẻ

<meta name="robots" content="noindex">vào thẻ<head>trong mã nguồn HTML. Lưu ý quan trọng: Khi đã dùng thẻnoindex, tuyệt đối không được chặn URL đó trong tệprobots.txt, vì bot cần phải truy cập được vào trang mới có thể “đọc” được lệnhnoindex.

Chiến lược chặn Bot rác và Bảo vệ cấu trúc đường dẫn nhạy cảm

Việc tối ưu hóa robots.txt ở cấp độ chuyên sâu không chỉ dừng lại ở việc điều hướng luồng thu thập dữ liệu của Google, mà còn đóng vai trò như một màng lọc kỹ thuật giúp bảo toàn tài nguyên máy chủ (Server Resources) và ngăn chặn sự rò rỉ các cấu trúc hệ thống không cần thiết.

Nhận diện và loại trừ Bot rác (Bad Bots & Scrapers)

– Website thường xuyên là mục tiêu quét dữ liệu của các công cụ SEO bên thứ ba (như AhrefsBot, SemrushBot, MJ12bot) hoặc các bot spam tự động.

– Hoạt động cào dữ liệu liên tục từ các đối tượng này có thể làm tiêu hao một lượng lớn băng thông, gây ảnh hưởng trực tiếp đến tốc độ tải trang đối với người dùng thật.

Cách triển khai: Để tiết kiệm tài nguyên, quản trị viên cần định danh chính xác tên của trình thu thập dữ liệu và chặn quyền truy cập trên toàn bộ cấu trúc site.

Plaintext

User-agent: AhrefsBot

Disallow: /

User-agent: SemrushBot

Disallow: /

Ngăn chặn thu thập dữ liệu tại các khu vực nhạy cảm

Việc để bot tìm kiếm tự do quét và hiển thị các trang chức năng trên trang kết quả tìm kiếm (SERPs) không chỉ lãng phí ngân sách cào dữ liệu (Crawl Budget) mà còn làm loãng giá trị SEO tổng thể của website. Quản trị viên cần chủ động thiết lập lệnh Disallow cho các nhóm đường dẫn sau:

-

Khu vực quản trị & Hệ thống: Các thư mục backend như

/wp-admin/,/cgi-bin/hoặc các tệp cấu hình lõi (có đuôi mở rộng.php,.inc). -

Khu vực xử lý giao dịch: Các trang mang tính cá nhân hóa hoặc luồng thanh toán e-commerce như

/cart/,/checkout/,/my-account/. -

Trang kết quả tìm kiếm nội bộ: Các đường dẫn động được sinh ra khi người dùng tìm kiếm trên web (thường chứa các tham số như

/?s=hoặc/?q=), nhằm tránh việc Google lập chỉ mục hàng loạt trang có nội dung mỏng (Thin Content).

📌 Lưu ý về Bảo mật (Security Warning): Tuyệt đối không sử dụng robots.txt như một công cụ bảo mật để che giấu các đường dẫn chứa dữ liệu mật (ví dụ: thông tin khách hàng, mã nguồn nội bộ).

Vì tệp robots.txt mang tính công khai (ai cũng có thể đọc được bằng cách gõ trực tiếp URL), việc đưa các đường dẫn tối mật vào lệnh Disallow vô tình biến nó thành một “bản đồ” chỉ điểm cho hacker.

Đối với các dữ liệu này, biện pháp duy nhất là sử dụng xác thực mật khẩu từ phía máy chủ (Server-side Authentication).

4. Quy trình triển khai và Checklist kiểm thử kỹ thuật (Implementation & Testing)

Quá trình đưa cấu hình robots.txt lên môi trường thực tế (Production) đòi hỏi độ chính xác tuyệt đối.

Bất kỳ sai lầm nào trong khâu thiết lập cũng có nguy cơ dẫn đến hiện tượng “Index Bloat” (phình to dữ liệu rác trên kết quả tìm kiếm) hoặc nghiêm trọng hơn là vô tình chặn luồng thu thập dữ liệu vào các trang đích (Landing Pages) chủ lực.

Các bước triển khai cốt lõi

-

Khởi tạo tệp: Tạo một tệp văn bản đơn giản (plain text) với tên định dạng chuẩn xác là

robots.txtvà được mã hóa dưới chuẩn UTF-8. -

Phân lập cấu trúc URL: Xác định và lên danh sách các thư mục, tham số động hoặc đường dẫn không mang lại giá trị SEO cần được điều hướng bot.

-

Khai báo chỉ thị: Viết các khối lệnh

User-agent, kết hợpDisallow/Allowvà khai báo đường dẫn Sitemap tuyệt đối. -

Cập nhật lên máy chủ: Tải tệp lên đúng vị trí thư mục gốc (Root Directory) của website.

Checklist cấu hình kỹ thuật (Implementation Checklist)

-

[ ] Vị trí lưu trữ độc tôn: Tệp bắt buộc phải tồn tại ở đường dẫn cấp cao nhất của tên miền (ví dụ:

[https://truecore.vn/robots.txt](https://truecore.vn/robots.txt)). Bot sẽ báo lỗi 404 và bỏ qua nếu tệp nằm ở thư mục con. -

[ ] Cấu trúc phân cấp lệnh: Đảm bảo

User-agent(như*hoặc đích danh bot) luôn là dòng bắt đầu cho mỗi khối quy tắc. -

[ ] Kiểm soát tham số động (URL Parameters): Khai báo chặn các tham số lọc, sắp xếp hoặc theo dõi phiên bản để ngăn chặn lỗi trùng lặp nội dung (Duplicate Content) làm cạn kiệt Crawl Budget.

-

[ ] Giải phóng tài nguyên kết xuất (Rendering): Đảm bảo tuyệt đối không dùng

Disallowcho các thư mục chứa tài nguyên tĩnh (CSS, JavaScript, Fonts, Hình ảnh). Googlebot cần cào các tệp này để kết xuất giao diện và đánh giá các chỉ số trải nghiệm người dùng (Core Web Vitals). -

[ ] Tích hợp Sơ đồ trang: Bổ sung ít nhất một lệnh

Sitemap: [https://domain.com/sitemap.xml](https://domain.com/sitemap.xml)ở đầu hoặc cuối tệp.

Checklist kiểm thử và giám sát (Testing & Monitoring)

-

[ ] Xác thực qua Google Search Console: Luôn chạy thử nghiệm mã lệnh thông qua công cụ Robots.txt Tester trong GSC trước khi áp dụng chính thức để phát hiện các quy tắc chặn chéo hoặc lỗi cú pháp.

-

[ ] Phân tích độc lập với HTTP Status Code: Lưu ý rằng

robots.txtkhông can thiệp vào mã phản hồi của máy chủ. Nếu bạn dùng trình duyệt ẩn danh truy cập vào một URL đang bị chặn bởiDisallow, trang đó vẫn tải bình thường và trả về mã 200 OK (chứ không phải 403 Forbidden hay 404 Not Found). Lệnh chặn chỉ có tác dụng với các trình thu thập dữ liệu đã được khai báo. -

[ ] Giám sát hiệu suất quét: Thường xuyên kiểm tra báo cáo Thống kê thu thập dữ liệu (Crawl Stats) trong GSC để đánh giá sự thay đổi về tần suất, khối lượng tải xuống của Googlebot sau khi cập nhật

robots.txt, đảm bảo luồng crawl đã tập trung vào đúng các trang mục tiêu.

5. Phân tích thực tiễn: Sai lầm, Hiểu lầm & Kinh nghiệm xương máu

Dù mang cấu trúc văn bản đơn giản, robots.txt lại là nơi “khởi nguồn” của nhiều sự cố rớt hạng SEO thảm họa nếu quản trị viên thiếu cẩn trọng. Dưới đây là những bài học thực tế trong quá trình triển khai Technical SEO:

Các lỗi chí mạng và Hiểu lầm tai hại

-

Lỗi “Chặn mù” toàn bộ website: Việc vô tình để lại lệnh

Disallow: /(chặn toàn bộ thư mục gốc) sau khi chuyển website từ môi trường staging sang môi trường live sẽ khiến toàn bộ domain bị Google de-index (xóa khỏi kết quả tìm kiếm). -

Lỗi cú pháp định danh: Viết sai tên Bot (ví dụ: gõ khoảng trắng

Google Botthay vì chuẩnGooglebot) sẽ khiến lệnh vô tác dụng. -

Hiểu lầm về “Bảo mật tuyệt đối”: Như đã đề cập, hacker và đối thủ có thể dễ dàng gõ

/robots.txtđể dò tìm các đường dẫn bạn đang cố che giấu. Tệp này không phải là lớp khiên bảo mật, nó chỉ là một biển báo điều hướng.

Case Study: Cứu vãn Crawl Budget cho trang E-commerce

– Vấn đề: Một website thương mại điện tử lớn bị lãng phí đến 60% ngân sách thu thập dữ liệu hàng ngày của Googlebot vào hàng chục ngàn URL sinh ra từ bộ lọc sản phẩm (màu sắc, kích thước, mức giá).

– Giải pháp: Áp dụng Pattern Matching để chặn toàn bộ tham số lọc: Disallow: /*?filter_*.

– Kết quả: Chỉ sau 2 tuần, tốc độ lập chỉ mục cho các sản phẩm mới tăng 40%, đồng thời thứ hạng của các danh mục chính (Category Pages) cải thiện rõ rệt do dòng chảy tín hiệu SEO không còn bị phân tán.

– Xử lý xung đột Noindex & Disallow: Nếu mục tiêu cuối cùng là xóa một trang khỏi Google, hãy ưu tiên dùng thẻ meta noindex và KHÔNG chặn URL đó trong robots.txt. Nếu bạn chặn trong robots.txt, bot sẽ bị bật ra ngay từ ngoài cửa, không thể vào trong để “đọc” được lệnh noindex.

– Nguyên tắc phân tầng: Luôn sắp xếp các quy tắc từ cụ thể đến tổng quát. Bot sẽ ưu tiên thực thi quy tắc có chuỗi ký tự dài hơn và chi tiết hơn.

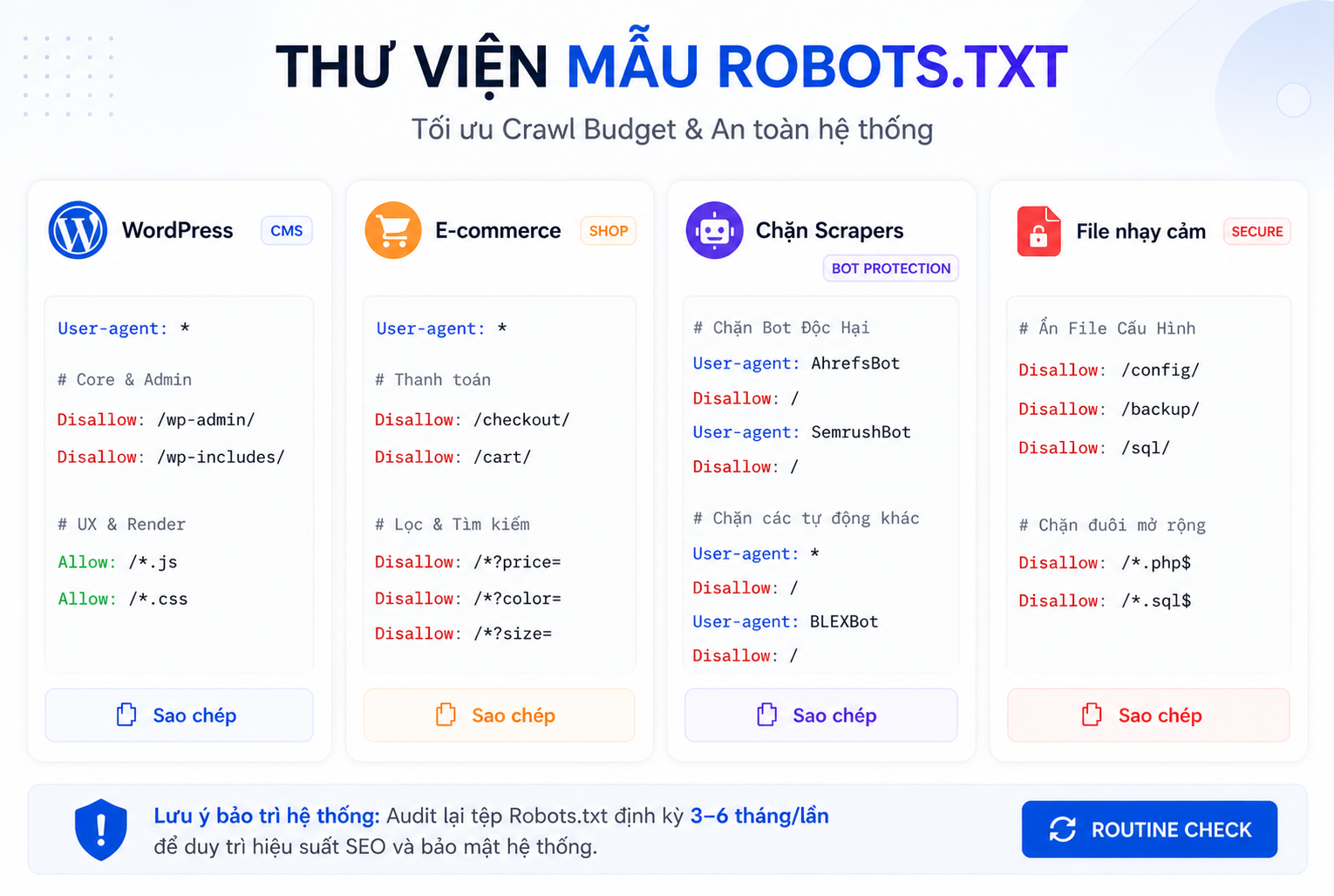

6. Thư viện Robots.txt tiêu chuẩn cho từng nền tảng

Dưới đây là các tệp cấu hình mẫu được tối ưu hóa dựa trên cấu trúc mã nguồn thực tế, giúp cân bằng hoàn hảo giữa hiệu năng Crawl, Indexing và an toàn hệ thống.

Mẫu tối ưu dành cho WordPress

Tập trung chặn các tệp lõi hệ thống nhưng vẫn mở quyền truy cập tài nguyên tĩnh (CSS/JS) để Google có thể render giao diện và đánh giá Core Web Vitals.

User-agent: *

# Chặn thư mục quản trị và file hệ thống cốt lõi

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /trackback/

Disallow: /xmlrpc.php

# Mở quyền truy cập tài nguyên để Render giao diện

Allow: /wp-admin/admin-ajax.php

Allow: /wp-content/uploads/

Allow: /wp-includes/*.js

Allow: /wp-includes/*.css

# Chặn kết quả tìm kiếm nội bộ tránh Thin Content

Disallow: /?s=

Disallow: /search/

Sitemap: https://truecore.vn/sitemap_index.xml

Mẫu bảo vệ Crawl Budget cho E-commerce (Magento, OpenCart…)

Ưu tiên hàng đầu là kiểm soát chặt chẽ các tham số bộ lọc (parameters) và các trang mang tính cá nhân hóa của khách hàng.

Plaintext

User-agent: *

# Chặn luồng thanh toán và dữ liệu cá nhân

Disallow: /checkout/

Disallow: /cart/

Disallow: /customer/

Disallow: /wishlist/

# Ngăn chặn tham số lọc sinh ra URL trùng lặp

Disallow: /*?price=

Disallow: /*?color=

Disallow: /*?size=

Disallow: /*?order=

Disallow: /*?limit=

Disallow: /*?dir=

# Chặn thư viện và logs hệ thống

Disallow: /lib/

Disallow: /setup/

Disallow: /var/

Sitemap: https://truecore.vn/sitemap.xml

Mẫu chặn Bot phân tích đối thủ & Scrapers

Bảo vệ cấu trúc và dữ liệu chiến lược khỏi các công cụ cào dữ liệu từ bên thứ ba. (Có thể dán đoạn này lên đầu bất kỳ tệp robots.txt nào).

# Ngăn chặn các công cụ phân tích SEO

User-agent: AhrefsBot

User-agent: SemrushBot

User-agent: MJ12bot

User-agent: DotBot

User-agent: Rogerbot

Disallow: /

# Chặn các bot cào dữ liệu tự động (Scrapers) rác

User-agent: BLEXBot

User-agent: MegaIndex.ru

Disallow: /

Mẫu hạn chế thu thập file cấu hình & Backup

Sử dụng để hạn chế bot quét trúng các tệp chứa thông tin cấu hình máy chủ hoặc file nén dữ liệu vô tình bị sót lại.

User-agent: *

# Ngăn thu thập các thư mục cấu hình và dự phòng

Disallow: /config/

Disallow: /backup/

Disallow: /logs/

Disallow: /tmp/

Disallow: /private/

Disallow: /sql/

# Ngăn thu thập các định dạng file nhạy cảm

Disallow: /*.php$

Disallow: /*.inc$

Disallow: /*.sql$

Disallow: /*.gz$

Lời kết từ Truecore: Tối ưu hóa robots.txt không bao giờ là câu chuyện “cài đặt một lần rồi quên”.

Cùng với sự mở rộng của cấu trúc website và sự xuất hiện liên tục của các trình thu thập dữ liệu mới, việc audit lại tệp này mỗi 3-6 tháng là bắt buộc để duy trì nền tảng Technical SEO khỏe mạnh và hiệu suất xếp hạng bền vững.

Tôi là Nguyễn Thị Thu Thảo – Đồng sáng lập Truecore.vn và sáng lập tuilathao.com với hơn 9 năm làm việc trong ngành công nghệ, dịch vụ doanh nghiệp và pháp lý số, Thảo lựa chọn trở thành người đứng sau những chuyển đổi mạnh mẽ, bền vững cho các doanh nghiệp – từ khi thành lập đến khi mở rộng thị trường.